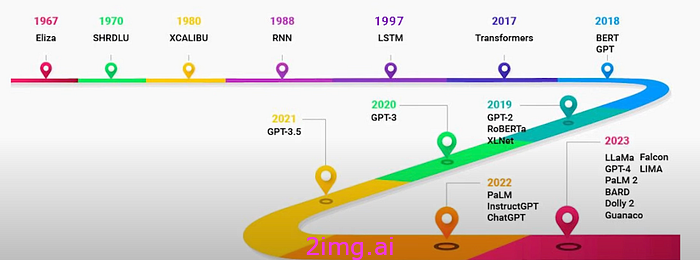

今天要簡單做一下 LLM 的歷史回顧。

●1960 年代: 第一個聊天機器人 ELIZA 誕生,它使用模式匹配和替換方法來創造對話的錯覺。

●1980 年代: 遞歸神經網路(RNN) 出現,能夠記住以前的輸入並根據上下文回答問題。

●1990 年代: 長短期記憶模型(LSTM) 出現,克服了 RNN 的短期記憶限制。

●2010 年代:

●2017 年: Transformer 架構 問世,依賴注意力機制來處理序列,並為 BERT、GPT 等後續模型奠定了基礎。

●2018 年至今: 大型語言模型(LLM) 出現,如 Google 的 BERT 和 OpenAI 的 GPT 系列,它們可以執行無數的任務。

(照片來源:https://www.youtube.com/watch?v=K7o5_Fj7_SY)